La préhistoire

A quand remonte l'histoire de la qualité ?

Nos ancêtres de la préhistoire bénéficiaient d’une qualité « implicite » : le concepteur d’un outil, son fabricant et son utilisateur n’étaient souvent qu’une seule et même personne ; pas besoin de spécifications et pas de risque d’insatisfaction du client.

Quelques temps avant notre ère

Plus tard, à l’horizon de 2000 ans avant JC, un roi babylonien (Hammourabi) eut l’idée d’un code de référence connu de tous. Ce code visait (déjà !) à définir le contrôle des produits finis et la responsabilité du fabricant vis-à-vis du client.

On trouve ainsi dans ce code des règles exprimées comme suit :

« Si le maçon a construit une maison trop peu solide et que cette maison s’est écroulée sur ses habitants, le maçon sera tué. ».

Radical comme sanction commerciale …

Il y a quelques siècles

Plus près de nous, au XVIIème siècle, Colbert exigeait un contrôle des fabrications de la part des manufactures œuvrant pour l’Etat.

On peut ainsi trouver dans ses écrits :

« Si nos fabriques imposent à force de soin la qualité supérieure de nos produits, les étrangers trouveront avantage à se fournir en France et leur argent affluera dans le royaume. ».

Une leçon à se réapproprier de nos jours ?

De 1850 à 1920

A l’arrivée de l’ère industrielle, on voit se développer la production de masse avec l’avènement de chaînes de production utilisant un personnel peu qualifié et payé « à la tâche » sans réel critère de qualité.

Pour pallier le manque de qualification, les tâches sont découpées en éléments simples et répétitifs dans l’objectif de réduire l’impact humain. Ceci est fort bien exposé dans « Les Temps Modernes » de C. CHAPLIN.

A la fin du XIXème siècle, Taylor met au point l’Organisation Scientifique du Travail (O.S.T.) qui instaure la division horizontale du travail (spécialisation des tâches, étude des temps) et la division verticale (séparation des tâches entre les concepteurs et les exécutants).

On est alors à l’ère de l’inspection, le contrôle étant relégué en fin de chaîne pour identifier et supprimer les « mauvais » produits.

Il faut noter que le manque de motivation dû à un travail rendu inintéressant par la segmentation poussée des tâches va engendrer une dégradation de la qualité … et un nécessaire surcroit d’inspection.

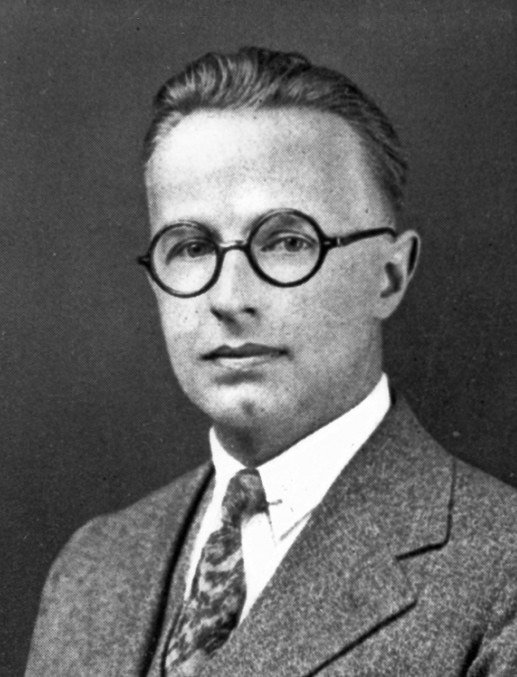

De 1920 à 1940

On assiste dans les années 1920 au développement de la métrologie et de la normalisation, via une prise en compte par les pouvoirs publics. En France, l’AFNOR (Association Française de Normalisation) nait en 1926.

Un des précurseurs de la qualité telle que nous l’entendons aujourd’hui est le Dr. Walter Shewhart, chercheur aux Bell Laboratories dans les années 1930-40. Il démontrera, à contre-courant de la pensée de l’époque, que le « bon » contrôle nécessite la collaboration de nombreuses personnes intervenant dans un processus de fabrication et à différents niveaux de responsabilité plutôt qu’un vérificateur de fin de production.

Shewhart mettra au point des techniques statistiques et de probabilités et des méthodes d’échantillonnage qui vont permettra à Bell Labs de faire des progrès considérables : diminution des coûts de réparation, augmentation de la productivité, meilleure uniformité des produits.

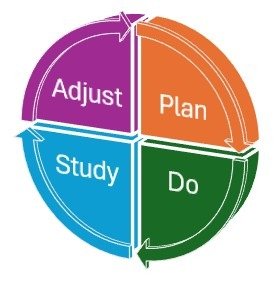

Shewhart proposera le cycle PDSA (Plan/Préparer, Do/Faire, Study/Étudier, Adjust/Ajuster) afin de travailler via des cycles itératifs d’amélioration de la qualité et de résolution de problèmes.

Un autre credo de Shewhart reposait sur le rôle de chaque membre d’une entreprise dans le processus d’amélioration de la qualité.

De 1940 à 1945

La 2nde guerre mondiale va accélérer l’histoire de la qualité et c’est l’armée américaine qui, la première, va énoncer des standards permettant de viser l’efficacité de la chaîne de production plutôt que de miser sur le contrôle en sortie.

L’armée, avec le concours de William Edwards Deming, disciple de Shewhart, va adopter des procédures statistiques pour la réception à la livraison des matériels et elle va inciter ses fournisseurs à mettre en œuvre des méthodes de contrôle statistique des procédés.

Convaincu que la réussite passe par les managers, Deming va organiser des stages pour apprendre les méthodes de Shewhart aux cadres supérieurs des entreprises d’armement. Ce sera un échec, les dirigeants industriels n’ayant pas conscience de leur responsabilité …

Deming prône que les méthodes statistiques doivent être simples, élémentaires, dénuées de formules, et que chacun, du PDG à l’opérateur, doit être en mesure de les comprendre et les appliquer.

Ces méthodes vont sonner le glas des inspections à 100%, si coûteuses et si peu efficientes. Outre-Atlantique, les industriels restent néanmoins dubitatifs devant ces nouvelles méthodes.

Voir les "14 principes de Deming" : Les 14 Points de Deming

L'après-guerre

Après la 2nde guerre mondiale, les acheteurs dans les secteurs de l’armement, de l’espace et du nucléaire vont faire pression sur les fabricants et exiger des preuves de la maîtrise de la qualité de fabrication afin de diminuer les contrôles et la surveillance.

C’est le Japon qui, le premier, va faire évoluer les principes de maîtrise de la qualité. Mis à mal par sa défaite en 1945, le Japon peine à se relever et son industrie produit des fabrications de qualité médiocre, entrainant une mauvaise réputation auprès des pays européens.

De 1945 à 1950, les USA délèguent sur place leurs experts (notamment Shewhart, Deming, ou encore Joseph Juran). Juran est le premier à avoir évoqué la notion de « coût de la non-qualité ». Il introduisit également le concept de « qualité totale » et celui de résistance au changement, évoquant par là-même l’influence de l’élément humain dans la qualité.

Juran défendra la vision d’une responsabilité qui incombe à la Direction et que cette Direction doit intégrer la qualité au titre d’une discipline de gestion, analogue à la gestion des finances.

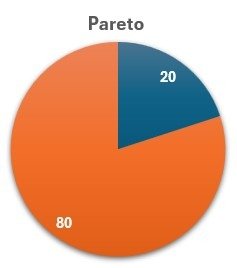

Dès les années 1960, Juran a défendu la trilogie Planification -> Contrôle -> Amélioration. Il est surtout connu pour avoir défini le diagramme de Pareto : mise en avant des problèmes par ordre d’importance ; 20% des causes produisant 80% des effets.

Voir la fiche pratique "Loi de Pareto".

Dans les mêmes années, Armand Feigenbaum sera le premier à utiliser le terme de « maîtrise totale de la qualité ». Moins connu que les autres experts précédemment cités, Feigenbaum définira également les composantes des coûts de la non-qualité : défaillance, contrôle, prévention.

Voir la fiche pratique "Evaluation des coûts de la non-qualité". Bientôt !

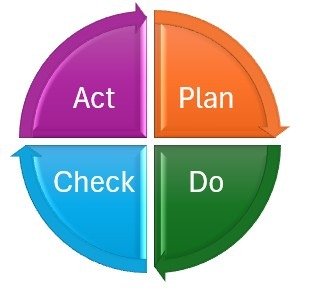

C’est au sein du JUSE (Japanese Union of Scientists and Engineers), créé en 1946 par le gouvernement japonais, que Deming et Juran intervinrent en tant que consultants auprès de l’industrie nippone. C’est là que Deming proposa sa fameuse roue PDCA (Plan / Do / Check / Act), base de tout principe d’amélioration continue.

Voir la fiche pratique "Roue de Deming - PDCA".

L’objectif premier de Deming n’était pas d’ajouter une composante qualité au management mais plutôt de transformer radicalement ce management. Ainsi, selon Deming :

« La plupart des défauts des produits sont provoqués par des défauts du management plutôt que par des ouvriers négligents »,

et il concluait lors d’une conférence en 1950 :

« Ma méthode, c'est la démocratie dans l'industrie. »

Zoom sur le Japon

L’homme-phare du Japon à cette époque est Kaoru Ishikawa. Son père, Ichiro, était président du Keidanren, l’équivalent de notre MEDEF.

Dès 1956 à la direction du Juse, Kaoru Ishikawa impulse des pratiques innovantes qui sont encore appliquées aujourd’hui. Au début des années 1960, il lance les « Cercles de Qualité ». Ces derniers perdurent encore au Japon, mais aux USA et en Europe, après un effet de mode, ils se sont arrêtés. Selon Ishikawa, cette fin est due aux Directeurs occidentaux qui ne s’intéressent pas vraiment aux principes et méthodes de la qualité totale.

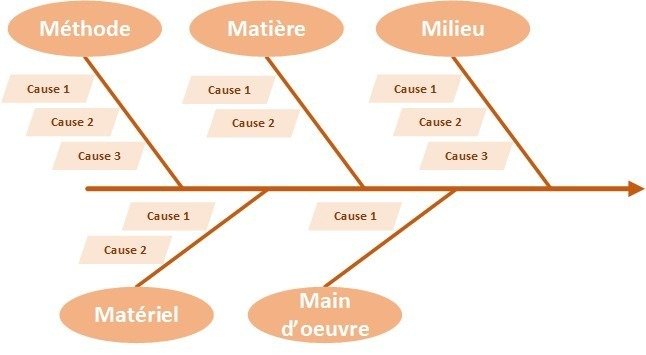

C’est également lui qui a bâti le concept de « diagramme cause-effet », plus connu sous le terme de « diagramme d'Ishikawa » ou d’« Arête de poisson ».

Voir la fiche pratique "Diagramme d'Ishikawa".

L’influence d’Ishikawa est telle qu’aujourd’hui le Japon est le seul pays au monde où les cadres dirigeants, dans la plupart des entreprises, utilisent les techniques de la qualité totale comme techniques de management.

C’est au Japon que sont nées plusieurs méthodes aujourd’hui utilisées par les qualiticiens. On peut citer : le « juste à temps », introduit par Taïchi Ono, dont dérivera ensuite le Kanban ; le SMED et le Poka Yoké, tous deux initiés par Shigeo Shingo. Tous sont issus du « modèle Toyota », souvent qualifié de Toyotisme.

Pendant que les occidentaux misaient sur l’image de la réussite individuelle, le Japon poursuivait une histoire où le collectif prime sur l’individu. Sans doute faut-il voir là le terreau propice à l’éclosion du mouvement qualité, grâce à la valorisation du travail en groupe.

Depuis 1980

Constatant le succès des entreprises japonaises, les USA commencent alors à remettre en question les pratiques de gestion de la qualité issues du taylorisme.

La donne a changé : l’offre est devenue supérieure à la demande et les consommateurs sont plus exigeants. La qualité devient un élément différenciant et un argument de vente.

C’est Phil Crosby qui va populariser les concepts de « Zéro défaut » et de « Bien faire dès la première fois »

Il s’insurgera tout d’abord contre une norme de qualité militaire qui accepte, dès la contractualisation, un certain pourcentage de pièces défectueuses.

Il va convaincre sa Direction qu’il est possible de mieux faire en faisant confiance au personnel. Il communiquera ensuite sur les risques commerciaux à ne pas atteindre la qualité attendue et insistera sur « faire bien la première fois ».

Crosby reste connu pour ses « 4 piliers de la qualité » :

- La qualité est définie en tant que conformité aux spécifications ;

- La qualité résulte de la prévention, pas du contrôle ;

- Le standard de performance doit être le Zéro Défaut et non pas une valeur de défaut « suffisamment faible » ;

- La qualité se mesure selon le prix de la non-conformité, pas selon des indices.

L'arrivée des normes ISO et leur évolution

Après des décennies de normes développées à travers le monde chez les militaires, dans l’industrie, par certaines corporations ou certaines nations, le panorama finissait par créer une certaine confusion dans les milieux industriels.

C’est ainsi que sont nées les normes ISO telles que nous les connaissons aujourd’hui. Ce sont les industriels, intervenant pour de grands donneurs d’ordre, qui ont souhaité faire reconnaitre leur système de gestion de la qualité dans le but de disposer d’un référentiel commun et ainsi éviter la multiplication des audits de leurs clients.

1987

Première version, centrée sur l’assurance qualité et très orientée sur la documentation avec quasiment 20 procédures obligatoires et un manuel exigé. Cette 1ère version était directement inspirée d’une norme britannique (BS 5750) parue en 1979.

La norme était alors déclinée en 3 axes :

- ISO 9001 : Modèle pour l’assurance de la qualité en conception/développement, production, installation et soutien après la vente

- ISO 9002 : Modèle pour l’assurance de la qualité en production et installation et le soutien après la vente

- ISO 9003 : Modèle pour l’assurance de la qualité en contrôle et essais finaux

1994

Cette première révision ne présente pas de bouleversement majeur. Les évolutions portent sur des clarifications liées à la partie conception et développement. Il y a toujours 3 normes ISO 9001, ISO 9002 et ISO 9003.

C’est l’époque où la qualité est assimilée à « Écrire ce que l’on fait (procédure), faire ce que l’on a écrit, écrire ce que l’on a fait (enregistrement) », avec toujours 17 procédures et un nombre conséquent d’enregistrements exigés. Cette phase entraînera une dérive "procédurière", éloignant le terrain de la qualité.

2000

Evolution fondamentale avec la fusion des 3 normes en une seule norme ISO 9001.

Cette nouvelle version s’attache notoirement plus au fond (satisfaction client, approche processus, maîtrise des fournisseurs, amélioration continue) qu’à la forme et allège considérablement la partie documentaire : Il n’y a plus que 6 procédures exigées, un manuel et une politique. Les entreprises ont alors la liberté de déterminer quelles autres procédures sont nécessaires à la maîtrise de leurs processus. L’approche est devenue plus globale et orientée « management de la qualité ».

2008

Cette version s’articule autour de 4 thèmes majeurs : Responsabilité de la Direction / Gestion des ressources / Réalisation du produit / Mesure, analyse et amélioration continue. Elle prépare une meilleure compatibilité avec la norme ISO 14001.

2015

Le manuel qualité n’est plus une obligation. La terminologie liée à tous les aspects documentaires a évolué vers les « informations documentées ».

Cette version a introduit les concepts de parties intéressées et de risques et opportunités. Elle a renforcé le pilotage par les processus et insiste sur une meilleure prise en compte du contexte de l’entreprise.

Cette version ne met plus d’obligation de nommer un responsable qualité, renforçant ainsi, de fait, la responsabilité du management de la qualité sur la Direction et le pilotes de processus qu’elle nomme.

La structure de la norme est désormais alignée sur celle des normes ISO 14001 et ISO 45001, facilitant la mise en œuvre d’une certification multi-référentiels.

Les principes de management ont également été révisés et sont désormais 7.

Et la prochaine version ?

L'organisation internationale ISO annonce une prochaine version de la norme ISO 9001 probablement pour l'automne 2026.

Les évolutions significatives devraient porter sur les thèmes suivants :

- Impact du changement climatique

- Résilience et adaptabilité de l'entreprise

- Culture qualité et éthique renforcées Traitement dissocié des risques et des opportunités dans la planification

- Digitalisation, outils numériques, intelligence artificielle

A suivre ...